· Tecnología Sanitaria · 9 min read

¿Consultora o decisora? Cómo el papel de la IA define la responsabilidad clínica

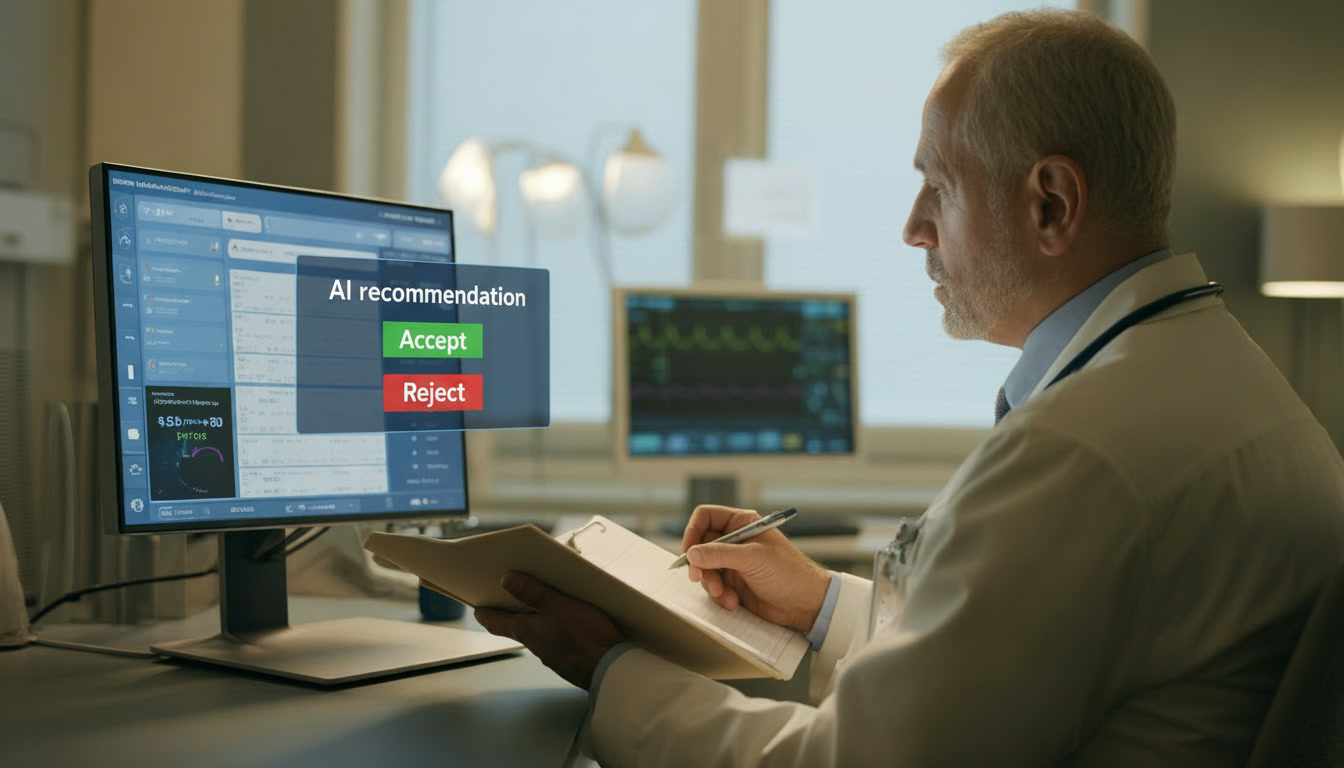

Cuando la IA decide y el humano supervisa, la responsabilidad clínica disminuye. Un estudio con 400 participantes analiza cómo el diseño del sistema condiciona la seguridad, la trazabilidad y el cumplimiento normativo en sanidad.

Desafíos en la Implementación de IA en Salud y la Importancia del Enfoque “Human in the Loop”: Análisis Teórico, Empírico y Operativo

Resumen

Objetivo

Se analizó, tanto teórica como empíricamente, el impacto del contexto en el que se introduce la automatización dentro de un sistema de toma de decisiones. El objetivo operacional se centra en entender cómo la integración de la IA influye en los flujos de trabajo clínicos, especialmente en el vínculo entre la función humana y la automatización.

Antecedentes

Los trabajos previos abordaron la causalidad y la responsabilidad en sistemas humano-automatización sin considerar los efectos de cómo se presenta el papel de la automatización a los usuarios. En un entorno asistencial, esto se traduce en que los profesionales pueden asumir diferentes roles según cómo el sistema se diseñe y despliegue, lo que impacta su participación y autonomía.

Métodos

Se adaptó un modelo analítico existente para predecir la contribución humana a los resultados, incorporando el contexto de la automatización. Operationalmente, este enfoque se vincula a cómo la IA se presenta en las interfaces clínicas (consultiva vs. decisional). Se llevó a cabo un experimento de detección de señales asistida con 400 participantes para evaluar la correspondencia entre el comportamiento observado y las predicciones del modelo.

Resultados

El contexto en el que se presenta el papel de la automatización influyó en la tendencia de los usuarios a seguir sus recomendaciones. Cuando la automatización tomaba decisiones y los usuarios solo la supervisaban, estos tendían a contribuir menos al resultado que en sistemas donde la automatización tenía una función meramente consultiva. Esto se manifiesta directamente en flujos operativos donde el profesional puede pasar de ser evaluador activo a mero supervisor, afectando la seguridad, eficiencia y cumplimiento.

Conclusión

La forma específica en que se integra la automatización en un sistema afecta a su uso y a la percepción de la implicación del usuario, pudiendo alterar el rendimiento global del sistema. Los sistemas que mantienen un control humano significativo tienden a favorecer una mayor responsabilidad, ajuste normativo y mejores resultados operativos.

Aplicación

Esta investigación puede ayudar a diseñar sistemas de toma de decisiones asistidos por automatización y aportar información sobre requisitos regulatorios y procesos operativos para este tipo de sistemas. En el contexto sanitario, implica la necesidad de estructuras flexibles que faciliten el ajuste entre automatización y control humano, asegurando cumplimiento normativo y experiencia clínica óptima.

Introducción

Los operadores humanos colaboran con sistemas automatizados de apoyo a la toma de decisiones para mejorar los resultados en tareas complejas. En el ámbito sanitario, esta colaboración se materializa en herramientas como sistemas de apoyo clínico, soluciones de triage automatizado y aplicaciones de monitorización remota.

Estos sistemas combinan capacidades humanas y automatizadas, pero generan dudas clave sobre responsabilidad, influencia y toma de decisiones. La integración de IA exige que el diseño considere cuidadosamente el reparto de roles, para evitar la reducción inadvertida de la implicación humana que puede derivar en disminución del control, brechas de seguridad o falta de cumplimiento.

Douer y Meyer propusieron un modelo basado en teoría de la información para cuantificar la responsabilidad humana como la información única que aporta al resultado. Esto es esencial en entornos clínicos donde la trazabilidad y la rendición de cuentas son requisitos regulatorios fundamentales.

Sin embargo, este modelo no considera el contexto en el que se presenta la automatización, lo cual puede alterar tanto la responsabilidad real como la percibida. Por ejemplo, el profesional sanitario puede ver mermada su capacidad de intervención si la IA es percibida como decisoria y no como consultiva, lo que se traduce en retos operativos, menores aportes individuales y posibles conflictos en la distribución de responsabilidades.

Ejemplo operativo contextual

En sistemas HIS (Hospital Information System), el módulo de decisión automática puede limitar que los médicos entren datos o ajusten recomendaciones, relegándolos a supervisores. Esto afecta su percepción de responsabilidad y modifica su carga de trabajo, como se recoge en experiencias de adaptación tecnológica y eficiencia administrativa (RAG).

Marco Conceptual y Teórico

El modelo de Douer y Meyer formula la responsabilidad humana como la cantidad de información única que el operador aporta al resultado final de la decisión conjunta humano-máquina. Este enfoque parte de la teoría de la información y utiliza variables como:

- I(U): Información aportada por el usuario (profesional sanitario)

- I(A): Información aportada por la automatización (IA)

- I(T): Información total del sistema

Se define formalmente:

I(R) = I(T) - I(A)

Donde I(R) representa la responsabilidad residual humana. En el entorno clínico, I(R) se traduce en la capacidad del médico o profesional de salud de influir en el diagnóstico, tratamiento o decisión administrativa final, incluso cuando la IA contribuye.

Este modelo permite cuantificar la participación humana en términos de información, teniendo en cuenta el diseño del sistema. Un sistema donde la IA decide y el humano supervisa reduce I(R); en cambio, un sistema consultivo donde el profesional puede aceptar/rechazar recomendaciones incrementa I(R).

Variable de contexto operativo

El contexto de automatización (decisional vs. consultivo) determina la forma en que el usuario percibe su rol y aporta información. Esto afecta directamente flujos de trabajo y el cumplimiento normativo, porque los requerimientos de trazabilidad e imputabilidad difieren según el grado de intervención humana.

Modelo Analítico

El modelo adaptado incorpora el contexto de presentación de la automatización. Si la IA se implementa como decisional, el usuario tiende a fiarse más y aportar menos información. Formalmente,

I(R) dec = I(T) - I(A_dec) I(R) cons = I(T) - I(A_cons)

donde I(A_dec) > I(A_cons).

En términos operativos, esto se traduce en la diferencia entre:

- Sistemas donde la IA ofrece una recomendación y el humano decide (consultivo)

- Sistemas donde la IA toma la decisión y el humano supervisa (decisional)

La predicción es clara: cuanto más decisional sea la IA, menor será la contribución del profesional de la salud al resultado, lo que puede disminuir el control humano y la capacidad de corrección de errores.

Ejemplo formal en sistemas sanitarios

En flujos de trabajo de monitorización remota, cuando el software genera alertas automáticas y solicita solo la validación del profesional, se observa:

- Menor intervención humana

- Posible automatismo en la gestión de alarmas (workload transferido)

- Riesgo de omisión de matices clínicos relevantes

Metodología / Experimento

Se diseñó un experimento de detección de señales asistida por automatización, involucrando 400 participantes. En el ámbito sanitario, esto puede equipararse al proceso de validación de algoritmos de IA para detectar patologías en radiología, donde el profesional revisa el resultado generado por la IA.

Se evaluó el comportamiento de los participantes bajo dos condiciones:

- Automatización decisional: IA toma una decisión, usuario la supervisa.

- Automatización consultiva: IA proporciona una recomendación, usuario decide.

Se midió la correspondencia entre el aporte humano previsto por el modelo y el comportamiento real, analizando variables como:

- Nivel de seguimiento de recomendaciones

- Aporte humano residual

- Tasa de error corregido

- Implicación percibida

Implicación operativa

El experimento refleja el dilema de la clínica real: en sistemas de apoyo al diagnóstico, si el profesional solo valida la decisión de la IA, su intervención se reduce y la oportunidad para identificar errores atípicos o matices relevantes disminuye. Esto afecta la seguridad del paciente y la eficiencia en el manejo de casos complejos.

Resultados

El contexto en el que se presenta el papel de la automatización influyó en la tendencia de los usuarios a seguir sus recomendaciones. En sistemas decisionales, los usuarios tendían a contribuir menos al resultado que en sistemas consultivos.

Impacto operativo

Los profesionales sanitarios que operan sistemas donde la IA es decisional muestran menor involucramiento activo, lo que en la práctica puede derivar en:

- Disminución del control sobre el resultado clínico

- Reducción de la capacidad de corrección de errores

- Aumento de la confianza ciega en el sistema automatizado

- Potenciales brechas regulatorias por falta de trazabilidad

En sistemas consultivos, donde el profesional debe interpretar y decidir sobre la recomendación de la IA, se mantiene:

- Mayor intervención humana

- Mejor rendimiento del sistema global

- Niveles superiores de cumplimiento regulatorio por mayor trazabilidad y responsabilidad

Ejemplo clínico contextual

El reto de la adaptación tecnológica en hospitales refleja la necesidad de que los profesionales mantengan control sobre la decisión. La integración de módulos decisionales en sistemas HIS puede generar resistencia, carga administrativa no deseada o pérdida de confianza si no se diseñan mecanismos claros para la intervención y la corrección humana.

Discusión

La forma específica en que se integra la automatización en un sistema afecta a su uso y a la percepción de la implicación del usuario, alterando el rendimiento global del sistema.

Razonamiento causa → efecto

- Diseño de automatización decisional → Usuario supervisa sin intervenir → Menor aportación individual → Mayor riesgo de errores no detectados

- Diseño consultivo → Usuario evalúa y decide → Aporte activo y responsable → Mejor seguridad y cumplimiento normativo

Implicaciones prácticas

- Seguridad del paciente

- Un diseño consultivo permite detectar errores clínicos inadvertidos por la IA.

- La supervisión pasiva reduce la capacidad de detectar anomalías.

- Eficiencia

- Sistemas demasiado automatizados pueden reducir el workload humano, pero pueden sacrificar calidad asistencial.

- Sistemas consultivos pueden aumentar la carga para el profesional, pero se compensa con mejor rendimiento global y corrección de errores.

- Cumplimiento normativo

- La trazabilidad de la decisión requiere participación humana activa, por tanto, el diseño debe asegurar que la IA no supla completamente el papel del profesional.

- Los procesos regulatorios valoran el control humano significativo, para evitar conflictos en la imputabilidad y la gestión de incidentes.

Ejemplo de aplicación

En el despliegue de soluciones de monitorización remota integradas en software de gestión clínica, se observa que la automatización debe equilibrar la reducción de carga administrativa con la necesidad de intervención médica directa para garantizar calidad y cumplimiento.

Conclusiones

El contexto en el que se presenta la automatización es clave para determinar:

- la responsabilidad humana

- el comportamiento del usuario

- el cumplimiento normativo

Diseñar correctamente ese contexto es esencial para garantizar un control humano significativo en sistemas automatizados.

Implicación para la operación sanitaria

Esta investigación ratifica la importancia de implementar IA en salud bajo principios “human in the loop”, donde el profesional disponga de herramientas para ejercer control efectivo, corregir errores y contribuir de manera significativa al resultado. El reto operativo es modular el grado de automatización asegurando flexibilidad y trazabilidad, ajustando los flujos de trabajo al estándar regulatorio y clínico.

Fuente

https://pmc.ncbi.nlm.nih.gov/articles/PMC12231881/

Próximo paso sugerido

Se recomienda evaluar los procesos actuales de integración de IA en su organización, identificando puntos críticos donde la interacción humano-máquina podría optimizarse o ajustarse para cumplir estándares regulatorios y de seguridad clínica. Iniciar un diagnóstico operativo permitirá definir un marco de gobernanza, integración y mejora continua orientada a resultados.